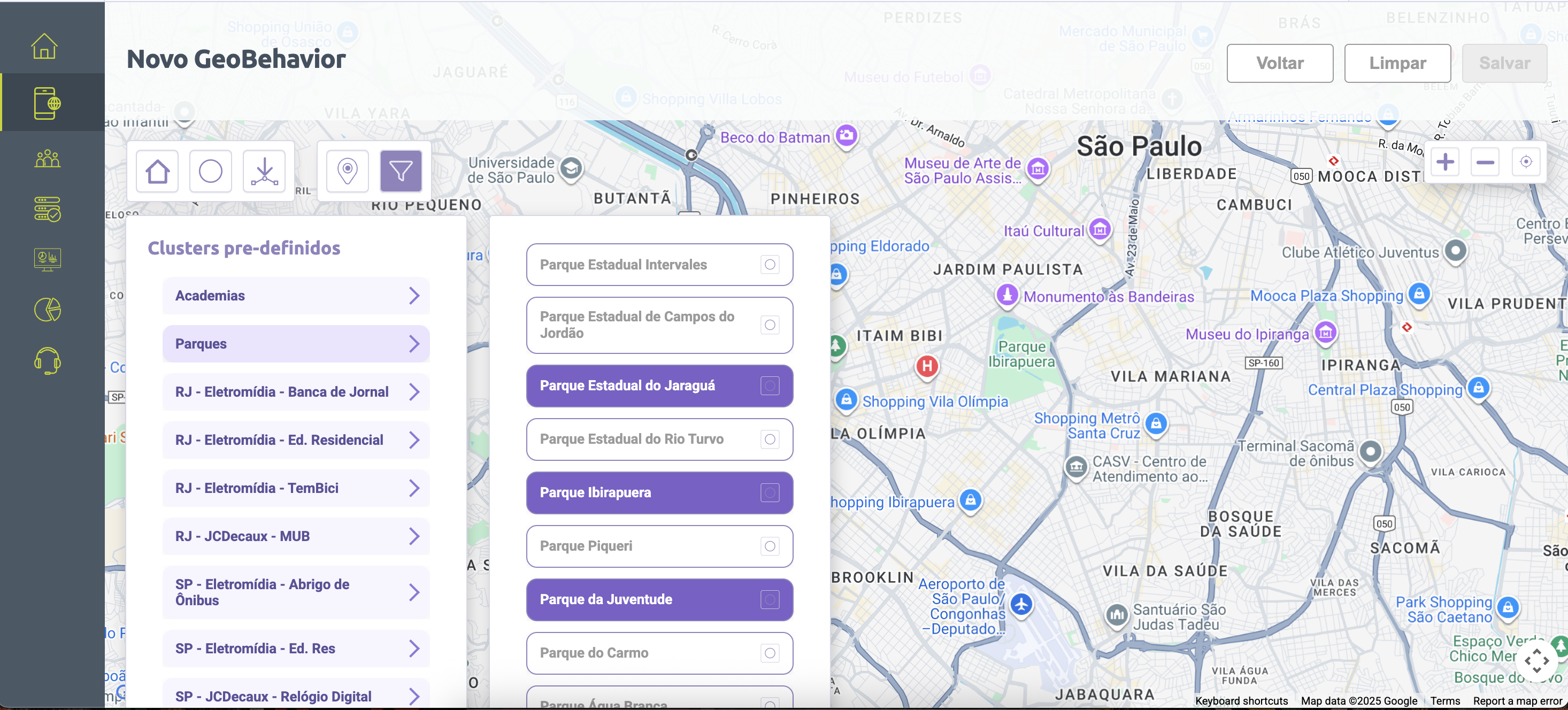

Geobehavior

GeoBehavior com foco em métricas e otimizações

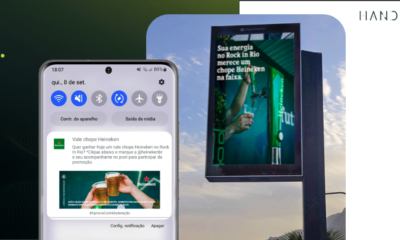

Não é apenas na segmentação de audiências que o GeoBehavior pode agregar valor às estratégias de mídia, tanto online quanto offline. Plataformas especializadas permitem o uso dos dados, da inteligência e da base de dados, para gerar análises e insights durante e após a campanha, trazendo mais efetividade e possibilidades de otimização e performance.

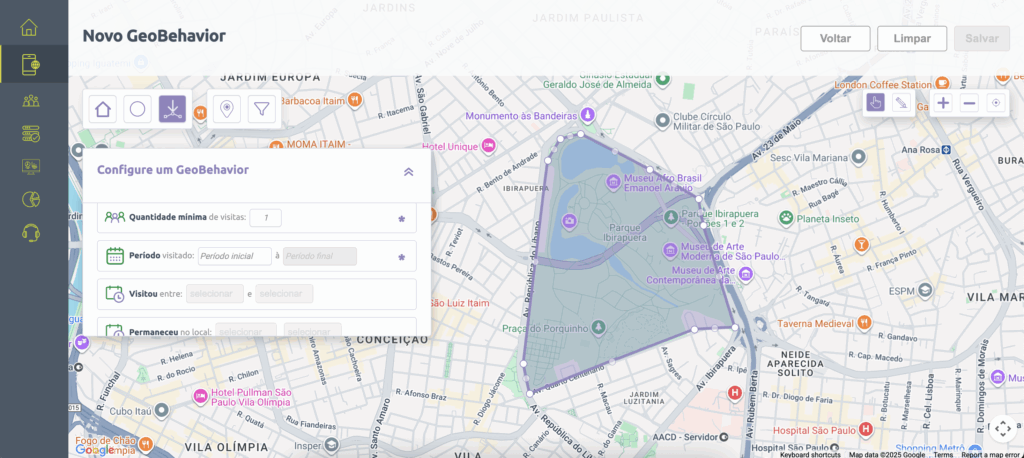

O foco principal está em utilizar os dados de geolocalização, enriquecidos pelas possibilidades do GeoBehavior. Desta forma, podemos utilizar os filtros precisos como por exemplo; pontos específicos no mapa (seja por raios ou por polígonos), data e hora das visitas, tempo de permanência e recorrência das visitas, além de diversos outros insights para gerar uma série de análises e métricas O2O (Online to Offline).

Drive to Store (DtS)

Trata-se de uma estratégia de marketing cujo objetivo é levar usuários do ambiente digital para visitas físicas a lojas, pontos de venda ou estabelecimentos pré definidos.

É o “guarda-chuva” sob o qual se encontram várias ações e métricas, como por exemplo Store Visits e Store Lift.

Vale ressaltar que o Drive to Store não é uma métrica em si, mas sim uma estratégia de campanha, que visa gerar tráfego offline.

Exemplos

- Uma campanha mobile com geotargeting que mostra um anúncio de promoção quando o usuário está próximo a uma loja.

- Um anúncio programático que leva o usuário a clicar em “Como chegar” e abre o Google Maps com a rota até o ponto físico.

Store Visits

Sendo parte de uma estratégia Drive to Store, o Store Visits é uma métrica, ou mecânica de campanha que utiliza a métrica na otimização.

O Store Visits tem como objetivo mensurar quantos usuários expostos a um anúncio digital visitaram fisicamente lojas ou PDVs pré determinados. Essa medição é feita por plataformas específicas que integram dados de geolocalização com exposição publicitária.

Como funciona?

- O usuário é impactado por um anúncio digital que permite a mediação de quais usuários (IDs) foram expostos e/ou impactados pela campanha.

- A plataforma verifica, via dados de geolocalização, quantos dos usuários impactados visitaram os locais.

- Se o local visitado, bem como data e horário da visita, assim como o tempo de permanência, forem compatíveis com uma visita real, é registrado um “Store Visit”.

Exemplo prático

- João é impactado pela mídia digital de uma rede de farmácias no celular.

- Dois dias depois, João entra em uma das lojas físicas.

- A plataforma reconhece o dispositivo e registra a visita.

Store Lift

Sendo também é uma métrica, ou mecânica de campanha que utiliza a métrica como forma de otimização, o Store Lift tem como objetivo medir o impacto incremental de uma campanha digital sobre o tráfego físico de visitas em lojas. Ou seja, quantas visitas adicionais foram geradas pela campanha, comparando com um grupo de controle (não exposto) ou versus um período pré campanha.

Importante:

- Store Visits = quantas pessoas impactadas foram até à loja.

- Store Lift = qual o fluxo incremental foi gerado em decorrência da campanha.

Como é calculado?

- Divisão entre grupo exposto e grupo controle (usuários semelhantes que não viram o anúncio) ou divisão das visitas pós campanha versus pré campanha.

Store Lift realizado com Grupo Exposto vs Grupo Controle:

Como é calculado: (Visitas expostos – Visitas controle) / Visitas controle

Exemplo prático:

- 1.000 usuários viram a campanha, e 150 visitaram a loja.

- 1.000 usuários não viram a campanha, e 100 visitaram.

- Store Lift = (150 – 100) / 100 = 50% de lift

Store Lift realizado analisando Pós Campanha vs Pré Campanha:

Como é calculado: (Visitas Pós Campanha – Visitas Pré Campanha) / Visitas Pré Campanha

Exemplo prático:

- Uma rede de lojas teve 10.000 visitas somadas em suas lojas da Região de Campinas no período pré campanha (30 dias).

- Após campanha realizada na mesma região, com foco em gerar visitas, o número de visitas no período posterior (30 dias), foi de 14.250 visitas.

- Store Lift = (14.250 – 10.000) / 10.000 = 42,50% de lift

Pontos Importantes do Store Lift:

- O Store Lift pode ser utilizado por necessidade ou por estratégia.

- O Store Lift por necessidade está relacionado aos casos nos quais não é possível ter a certeza sobre quais usuários foram, ou não foram, literalmente impactados por uma campanha.

- Ou seja, sabemos que uma audiência esteve na segmentação de potencial impacto, mas não temos como ter a certeza e nem a identificação técnica do impacto para analisar a visita.

- Isso pode ocorrer no caso de veiculação em plataformas digitais que não forneçam esse tipo de informação pós impacto e/ou interação.

- O Store Lift por estratégia acontece quando, mesmo nos casos nos quais exista a possibilidade de fazer a análise de usuários impactados, existe o interesse de analisar a efetividade versus outras estratégias, outros períodos etc. Isso porque o Store Visits, por essência, analisa o impacto individual da campanha, enquanto o Store Lift mensura o incremento de estratégias e segmentações. Desta forma, o Store Lift por estratégia é utilizados em situações como:

- Existe o interesse em comparar períodos

- Existe o interesse em comparar cenários

- Existe o interesse em realizar a análise em canais alternativos, ou offline, como no caso de OOH, no qual podemos analisar as audiências que estiveram na região de potencial impacto, opportunity to see (OTS) das campanhas, mas não temos certeza sobre o real impacto, mas podemos comparar o quando a audiência de um mesmo local de OOH (uma estação de metrô por exemplo) aumento o volume de visitas em determinada loja ou rede de lojas (mais detalhes no Capítulo OOH + Mobile).

- O Store Lift e o Store Visits, não são excludentes e podem ser utilizados de forma combinada, lembrando apenas que, toda análise de Store Visits pode conter uma análise de Store Lift porém, nem toda análise de Store Lift pode conter uma análise de Store Visits.

Store Share Lift (SSL)

Sendo um conceito complementar ao Store Lift, mas com foco em mensurar a participação de mercado nas visitas físicas, o Store Share Lift (SSL) mede o quanto uma campanha ajudou uma marca a aumentar sua fatia de visitas a lojas comparado aos concorrentes, em vez de apenas medir o aumento absoluto de visitas.

O Store Share Lift (SSL) é então a variação incremental na participação de visitas em loja geradas por uma campanha em relação à concorrência. Ele permite entender se a marca ganhou mais share de tráfego físico após uma campanha de mídia – ou seja, eficiência competitiva.

Enquanto o Store Lift responde:

“A campanha levou mais pessoas à minha loja?”

O Store Share Lift responde:

“A campanha fez com que mais pessoas escolhessem minha loja ao invés do concorrente?”

Como é calculado?

- Antes da campanha é analisada, via dados de geolocalização, a participação da marca nas visitas totais às lojas da categoria.

- Exemplo:

- Marca A: 25%

- Concorrente B: 35%

- Concorrente C: 40%

- Exemplo:

- Depois da campanha é realizada novamente a análise dessa distribuição.

- Fórmula de Calculo: Store Share Lift (%) = ((Share pós-campanha – Share pré-campanha) / Share pré-campanha) × 100

- No exemplo prático acima, em que antes da campanha a marca A tinha 25% das visitas entre todas as lojas da categoria, imagine que ela conseguiu subir esse share para 32%, o calculo seria: SSL = ((32 – 25) / 25) × 100 = 28% de Store Share Lift

Quando o Store Share Lift é utilizado?

- Além de, obviamente trazer um olhar importante sobre concorrência, o Store Share Lift é utilizado no caso de categorias que possuem muita sazonalidade e flutuação de visitas, e desta forma analisar puramente a sua campanha, sem comparar com os concorrentes, pode trazer análises equivocadas de sucesso ou insucesso de campanhas quando na verdade, comparando com os demais concorrentes, o cenário pode ser outro.

Pontos importantes ao utilizar geolocalização como estratégia ou métrica de campanhas:

- Não confundir relatórios de Drive to Store com métricas de resultados efetivos de visitas, pois em muitos casos esse tipo de relatório costuma reportar o número de usuários impactados pela campanha que “passaram” pelo ponto determinado, mas não que visitaram o local. Na dúvida, sempre questione as métricas e parâmetros de análise.

- Para quaisquer relatórios de mensuração e análise de visitas é importante sempre pedir a transparência, analisar e considerar:

- Raio ou polígono determinado para a análise, para garantir que está sendo considerado apenas o Ponto de Venda ou Loja e não uma região maior que o local.

- Data e horário das visitas para garantir que ocorreram nos horários em que o ponto estava aberto.

- Tempo de permanência, para garantir que não foram usuários que simplesmente passaram pela frente. Cada caso, estabelecimento ou estratégia pode contar com tempos de permanência distintos, mas sempre vale a atenção.

- Outro ponto importante é separar na análise os tipos de visitas, que de forma geral podem ser agrupadas em:

- Novas visitas: ou seja, usuários (IDs) que não tinham visitado os pontos anteriormente, dentro do período definido entre as partes. Esse tipo de visita tem como valor o fato de estar atraindo novos clientes para o ponto de venda.

- Recorrentes: ou seja, usuários (IDs) que já frequentam os pontos. Esse tipo de visita deve ser analisada como uma estratégia de; (a) retenção, garantido a manutenção das visitas dos clientes atuais ou (b) upsell, analisando se neste grupo houve um incremento no volume de visitas.

- Reengajamento: ou seja, usuários (IDs) que já frequentaram os pontos no passado mas deixaram de frequentar desde um período pré determinado. Esse tipo de visita deve ser analisada como uma estratégia de recuperação de clientes, seja porque deixaram de visitar a categoria de PDVs do anunciante, ou porque passaram a frequentar lojas ou PDVs de concorrentes.

- Uma estratégia bem desenhada de geolocalização tende a analisar, ter métricas e KPIs, bem como valor de visita, diferentes para cada tipo de visita, em cada período.

- Outro ponto a ser considerado é o período de análise pós campanha, ou seja, qual o prazo de atribuição de visitas após a campanha e/ou impacto.

- Por fim, considerando todas as diversas possibilidades e variáveis, um grande desafio hoje em dia é comparar estratégias e canais sem antes padronizar essa análise para se comparar números, dados e resultados com base nos mesmos critérios.

Dados & Estratégia

Model Context Protocol (MCP): por que o contexto virou a camada mais crítica da IA

O Model Context Protocol (MCP) é um padrão que define como modelos de IA acessam dados, ferramentas e sistemas externos de forma estruturada. Na prática, ele cria uma camada intermediária entre o modelo e o mundo real. Em vez de depender de integrações pontuais ou de contexto “injetado” via prompt, o modelo passa a operar sobre recursos organizados, com regras claras de acesso e formatos definidos.

Isso resolve um problema que até agora vinha sendo tratado de forma improvisada: o acesso ao contexto. E aqui está o ponto que muda o nível da discussão.

A maior parte das conversas sobre IA em mídia ainda gira em torno de modelo, prompt e automação. Isso é confortável. É tangível. Dá pra testar rápido. Mas não é onde o sistema quebra.

O modelo só responde ao que ele consegue acessar. E hoje, esse acesso, o contexto, ainda é a parte mais frágil de toda a arquitetura. Então não, o problema não é inteligência.

O problema é o que alimenta essa inteligência.

O modelo não erra sozinho. Ele erra com o contexto que você deu.

Quando uma IA entrega uma resposta ruim, a reação padrão é culpar o modelo. Só que na prática, o erro quase sempre está antes. O modelo depende de três coisas para operar fora do seu próprio conhecimento: descobrir dados, acessar esses dados e interpretar corretamente o que recebeu.

Hoje, essas três camadas são resolvidas de forma improvisada.

Cada integração é única. Cada fonte de dado chega em um formato diferente. Cada uso exige adaptação manual. Isso cria um cenário previsível: inconsistência, baixa confiança e decisões que parecem certas, até não serem. Então não é que o modelo “alucina”. Ele só está operando em cima de um contexto mal estruturado.

O MCP entra exatamente onde o sistema quebra

Se o problema está no acesso ao contexto, melhorar o modelo não resolve. O MCP resolve. Ele padroniza como dados, ferramentas e sistemas são expostos para o modelo. Isso significa que o modelo não precisa mais “adivinhar” o que existe ou como usar. Ele passa a operar sobre interfaces claras.

Na prática, isso elimina três fricções estruturais: o modelo passa a saber o que está disponível, como acessar e como interpretar.

Ou seja, o que antes era improviso vira arquitetura.

Contexto deixou de ser input. Virou infraestrutura.

Aqui está a mudança que a maioria ainda não entendeu. Hoje, contexto é tratado como algo que você injeta no prompt. Um apoio. Um complemento. Com MCP, contexto vira base operacional.

Os dados deixam de ser texto solto e passam a ter estrutura. As ferramentas deixam de ser chamadas improvisadas e passam a ter função definida. O acesso deixa de ser aberto e passa a ser governado. Isso muda completamente o tipo de problema que pode ser resolvido. Sem estrutura, IA responde. Com estrutura, IA opera.

Esse movimento já aconteceu na mídia

Durante muito tempo, a segmentação em mídia digital foi construída dentro das próprias plataformas.

Google, Meta, DV360. Cada ambiente definia quais dados estavam disponíveis, como esses dados eram organizados e quais critérios podiam ser usados para segmentação. Na prática, isso criava uma dependência total da lógica de cada canal.

Se a estratégia fosse impactar pessoas com determinado comportamento — como frequentadores de shopping ou visitantes de uma rede de lojas — essa definição ficava limitada à interpretação da própria plataforma, geralmente baseada em proxies frágeis como interesse declarado ou navegação. Isso funcionava enquanto o objetivo era escala.

Mas começou a quebrar quando o mercado passou a exigir precisão, consistência entre canais e maior controle sobre quem estava sendo impactado. O ponto de ruptura veio quando duas pressões começaram a acontecer ao mesmo tempo.

De um lado, a perda de sinal e as restrições de privacidade reduziram drasticamente a qualidade e a granularidade dos dados dentro das plataformas. Do outro, a operação de mídia ficou mais complexa, exigindo consistência de audiência entre múltiplos canais.

Nesse cenário, depender do dado nativo de cada plataforma deixou de ser solução e passou a ser problema. A mesma audiência era definida de formas diferentes em cada canal. Não havia garantia real de quem estava sendo impactado. E qualquer tentativa de integração virava adaptação manual.

A resposta do mercado não foi melhorar o uso das plataformas. Foi tirar a construção de audiência de dentro delas. Começaram a ganhar espaço estruturas como CDPs, DMPs e hubs de audiência, onde a lógica muda completamente: a audiência deixa de ser o que a plataforma permite e passa a ser um ativo estruturado antes da ativação.

Em vez de trabalhar com categorias genéricas como “interesse em varejo”, passa a ser possível definir audiências com base em comportamento real, como pessoas que visitaram lojas específicas, com frequência mínima e dentro de um determinado período.

Esse tipo de construção não nasce no canal. Ele nasce fora e depois é distribuído.

O ganho aqui não é incremental. É estrutural.

Você separa o dado do canal. Define quem impactar independentemente de onde vai impactar. Garante consistência entre plataformas. E deixa de depender da inteligência limitada de cada ambiente de mídia.

E é exatamente esse tipo de separação que o MCP começa a introduzir no universo de IA.

Hoje, muitos modelos ainda operam presos ao contexto que conseguem acessar diretamente, seja via prompt, integrações pontuais ou conexões específicas. Isso é equivalente à lógica antiga da mídia, onde a decisão dependia do ambiente.

Com MCP, o contexto passa a ser estruturado fora do modelo. Fontes são definidas, acessos são padronizados e o modelo passa a consumir esse contexto de forma organizada.

O paralelo aqui não é conceitual. É operacional. Assim como a mídia evoluiu quando separou dado de canal, a IA começa a evoluir quando separa contexto de modelo.

A Hands já opera nessa lógica mesmo sem chamar de MCP

Quando a Hands estrutura audiência, ela já está resolvendo um problema que o mercado ainda tenta empurrar para as plataformas. No Audience Hub, por exemplo, a audiência não nasce limitada por canal. Ela é construída com base em comportamento real, com granularidade de localização e filtros que as plataformas não oferecem. Depois, ela é distribuída para onde fizer sentido ativar .

Isso é mais do que segmentação. É organização de contexto antes da execução.

Agora conecta isso com MCP e o nível muda

Se hoje a audiência é usada para ativação, com MCP ela passa a ser usada para decisão. Porque ela pode ser exposta como um recurso estruturado. Isso significa que sistemas, não só campanhas, podem consumir esse dado. O que antes era “quem impactar” vira “como decidir”. E isso desloca completamente o papel da mídia dentro da operação.

Quando contexto vira protocolo, execução vira commodity

Aqui está o ponto que pouca gente está preparada para encarar. Se o acesso ao contexto é padronizado, o modelo deixa de ser diferencial. Se a ativação é multicanal e interoperável, o canal deixa de ser diferencial. Se a execução pode ser automatizada, a operação deixa de ser diferencial.

O que sobra?

A estrutura do contexto. Quem organiza melhor o dado antes da decisão passa a ter vantagem estrutural. Não incremental. Estrutural.

Quem ainda está discutindo campanha já está atrasado

O mercado ainda está focado em otimizar campanha. Melhor criativo, melhor segmentação, melhor performance. Tudo isso continua importante, mas está um nível abaixo do que está mudando. A nova camada não é execução. É decisão. E decisão depende de contexto.

No fim, MCP não muda a IA. Muda quem manda nela.

Se antes a pergunta era “qual modelo usar”, agora passa a ser outra:

quem define o contexto que esse modelo acessa?

Porque no limite, é isso que determina:

- o que entra na análise

- o que é ignorado

- e qual decisão é possível

E aí não estamos mais falando de tecnologia. Estamos falando de controle. E quem controla o contexto não melhora resultado.

Define o jogo.

Dados & Estratégia

Amostra Estatística em Marketing Digital: o que está por trás das audiências que você usa todo dia

Meta description: Entenda como a amostra estatística em marketing digital define a qualidade das suas audiências — e o que separa uma segmentação confiável de um chute bem embalado.

Toda campanha de mídia digital começa com uma pergunta que quase ninguém faz em voz alta:

Essa audiência representa quem eu acho que representa?

Na maioria das vezes, a resposta honesta seria: não sei. E isso tem um nome técnico, erro amostral. O problema é que o mercado de mídia programática trata audiências como fatos consolidados, quando muitas delas são, na melhor das hipóteses, estimativas estatisticamente frágeis.

Entender amostra estatística em marketing digital não é exercício acadêmico. É o que separa uma decisão de investimento embasada de uma aposta com linguagem técnica.

O que é amostra estatística e por que isso importa para quem compra mídia

Em estatística, população é o conjunto completo de elementos que você quer estudar. Amostra é o subconjunto que você consegue de fato observar.

No contexto de mídia digital, a população seria o universo total de pessoas que você quer atingir, todos os consumidores de uma categoria, todos os frequentadores de um tipo de estabelecimento, todos os decisores de compra de um segmento. A amostra é o grupo que sua plataforma de audiência conseguiu identificar e segmentar.

O que poucos param para avaliar: qual é a relação entre esses dois números? Se você quer atingir 500 mil pessoas e sua audiência tem 12 mil devices, o que essa audiência realmente representa? Ela é suficientemente grande? Ela foi construída com critérios que garantem representatividade? Ou ela captura apenas a fração mais acessível e não necessariamente a mais relevante?

Essas perguntas não são apego exagerado a estatistica. Elas determinam se o resultado da sua campanha vai refletir a realidade do mercado ou um viés que você não sabia que existia.

As três dimensões de qualidade que toda audiência precisa responder

Antes de ativar qualquer segmentação, independente da plataforma ou da fonte de dados, existem três dimensões que determinam se você está trabalhando com uma audiência estatisticamente sólida ou com uma que vai gerar conclusões difíceis de interpretar.

1. Volume em relação ao universo-alvo

Existe um limiar mínimo abaixo do qual qualquer resultado de campanha é estatisticamente inconcluso. Uma audiência muito pequena em relação à população que se propõe a representar amplifica o efeito de comportamentos atípicos e pode distorcer completamente a leitura de performance.

O tamanho adequado depende de dois fatores: o quanto a população-alvo é heterogênea em comportamento, e o nível de confiança que você precisa nas conclusões. Não existe número universal, mas o princípio é consistente: quanto mais diverso o comportamento da população que você quer atingir, maior precisa ser a audiência para representá-la com fidelidade.

A pergunta prática não é só “quantos devices tem essa audiência?” mas “quantos devices tem essa audiência em relação ao universo real que ela pretende representar?”

2. Origem e processo de construção

A forma como uma audiência é construída determina quem ela captura bem e quem ela sistematicamente deixa de fora. Audiências baseadas em dado declarado capturam quem se dispõe a declarar. Audiências baseadas em um único tipo de fonte de dados refletem as características dos usuários daquela fonte, não necessariamente da população total.

Isso não é um defeito de nenhuma metodologia específica, é uma propriedade estrutural de qualquer processo amostral. O que importa é conhecer o critério de construção para entender os limites da representatividade. Uma audiência construída com critérios transparentes e documentados permite que você use os resultados com o nível de confiança adequado. Uma audiência construída como caixa-preta não.

3. Aderência geográfica e temporal ao contexto da campanha

Uma audiência construída com dados de uma região pode não se comportar da mesma forma que a população de outra, mesmo com perfil demográfico similar. Padrões de deslocamento, frequência de visita a estabelecimentos, tempo de permanência, tudo isso varia geograficamente de formas que dados agregados não mostram.

O eixo temporal tem o mesmo peso: uma audiência capturada numa janela sazonal específica carrega o comportamento daquele período. Usá-la fora desse contexto sem considerar essa variável é introduzir um erro que nenhum algoritmo de otimização vai identificar, porque ele não sabe que o problema existe.

Quando a amostra deixa de ser amostra: o caso dos dados comportamentais passivos

Aqui está o ponto que muda a conversa.

A lógica amostral tradicional, selecionar um subgrupo para inferir o comportamento do todo, existe por uma razão prática: coletar dados de toda a população é inviável. Você não consegue entrevistar 50 milhões de consumidores. Você não consegue observar todos os comportamentos de compra em tempo real.

Mas quando falamos de dados de geolocalização comportamental coletados passivamente, a lógica muda.

Um polígono geográfico, a delimitação exata de um shopping, de um aeroporto, de uma avenida, de uma área residencial, garante que apenas os dispositivos detectados dentro daquela área específica entram na audiência. Não há extrapolação de raio, não há contaminação de passantes fora do contexto. O que é capturado, é capturado com precisão de contorno.

Isso não é uma amostra no sentido estatístico clássico. É uma captura censitária dentro de um universo definido.

A diferença prática é significativa: você não está inferindo quantas pessoas frequentam aquele aeroporto, nem estimando com margem de erro qual é o perfil de quem visita aquela avenida. Você está trabalhando com o registro comportamental real, hora de chegada, tempo de permanência, frequência de retorno, padrão de dias da semana, de todos os dispositivos detectados naquele espaço.

Isso elimina os dois principais problemas de amostragem discutidos acima: o viés de seleção (porque o critério de inclusão é puramente geográfico e comportamental, não demográfico ou declarado) e a não representatividade (porque a audiência é a população daquele comportamento naquele espaço, não uma estimativa dela).

O que resta como limite não é mais estatístico, é de cobertura. Qual percentual do universo de dispositivos reais está dentro do banco de dados da plataforma? Essa é a pergunta certa a fazer. E a resposta varia muito dependendo da fonte de dados e da metodologia de coleta.

Amostra estatística em marketing digital na prática

Considere uma marca de produtos de higiene pessoal que quer ativar uma campanha para consumidores de supermercados premium em três capitais brasileiras.

Abordagem A — audiência por dados declarados: A plataforma constrói uma audiência baseada em perfil demográfico e interesse autodeclarado. 180 mil devices. O problema: quem declara interesse em “produtos premium” num formulário ou numa navegação web não é necessariamente quem entra num supermercado premium toda semana. A audiência é uma amostra com viés de seleção enorme, captura quem pensa que compra nesse canal, não quem efetivamente compra.

Abordagem B — audiência por comportamento geolocalizado: A plataforma delimita os polígonos exatos das unidades dos supermercados premium nas três capitais. Detecta todos os dispositivos que estiveram presentes dentro desses polígonos pelo menos duas vezes no último trimestre, com tempo de permanência mínimo de 20 minutos, o que elimina passantes e funcionários. Resultado: 94 mil devices.

O número é menor. Mas o que esses 94 mil devices têm em comum é um comportamento verificado, não uma declaração. A “amostra” aqui não é uma estimativa de quem frequenta supermercados premium, ela é o registro de quem frequentou, dentro do universo de cobertura da plataforma.

Para a marca, a pergunta relevante não é “qual audiência tem mais volume?” mas “qual audiência está mais próxima da população real que eu quero atingir?” e a resposta muda o critério de avaliação de qualidade de audiência completamente.

O que perguntar antes de confiar em qualquer audiência

Se você é responsável por decisões de mídia e quer aplicar o raciocínio de amostra estatística no dia a dia, essas são as perguntas que valem fazer antes de ativar qualquer segmentação:

Sobre o universo:

- Qual é a população real que esta audiência deveria representar?

- Existe alguma estimativa do tamanho total dessa população para comparar com o volume da audiência?

Sobre o processo de construção:

- Qual foi a fonte dos dados? Declarado, comportamental passivo, inferido por modelo?

- Qual foi a janela temporal de coleta? Ela é compatível com o comportamento que você quer capturar?

- Existe algum critério de seleção que pode estar sistematicamente excluindo um subgrupo relevante?

Sobre os limites:

- Qual é a cobertura geográfica real da fonte de dados?

- A audiência foi construída com dados de uma única fonte ou com dados enriquecidos de múltiplas origens?

Não existe audiência perfeita. Existe audiência cujos limites você conhece e audiência cujos limites você ignora. A diferença entre as duas não está no CPM, está na capacidade de interpretar corretamente o que a performance da campanha está te dizendo.

Conclusão: amostra estatística em marketing digital não é teoria, é critério de compra

O mercado de mídia digital evoluiu muito na capacidade de criar e ativar audiências. Evoluiu menos na cultura de questionar a qualidade estatística dessas audiências antes de investir nelas.

Entender amostra estatística em marketing digital é, na prática, desenvolver um critério mais rigoroso para avaliar o que você está comprando quando compra uma audiência. É a diferença entre otimizar uma campanha dentro de um viés que você não sabe que existe e tomar decisões com dados que têm correspondência real com o comportamento de mercado.

A tecnologia de dados comportamentais passou por uma mudança de paradigma nos últimos anos. A capacidade de capturar comportamento real, onde as pessoas vão, com que frequência, por quanto tempo, sem depender de dado declarado ou de inferência demográfica, aproxima a audiência digital do censo comportamental e afasta do problema clássico de amostragem.

Conhecer essa diferença é o que permite usar audiências com a precisão que elas oferecem e não com a imprecisão que você não sabia que estava aceitando.

Quer entender como os dados de geolocalização comportamental da Hands são construídos e como isso afeta a qualidade das audiências que você ativa? Fale com nosso time.

Geobehavior

Audience Hub: como funciona a tecnologia por trás da segmentação precisa da Hands

Em um mercado em que todos são impactados por milhares de anúncios por dia, o verdadeiro desafio do marketing digital não é falar com mais pessoas, é falar com as pessoas certas, e o principal, conseguir ter a transparência, a autonomia e o controle sobre essas audiências. Foi justamente pensando nisso que a Hands criou e desenvolveu o Audience Hub, a plataforma proprietária da Hands criada para transformar dados de comportamento e localização em segmentações precisas e exclusivas com possibilidade de ativação em múltiplos canais de mídia.

Mas afinal, como essa tecnologia funciona?

O ponto de partida: dados de geolocalização e comportamento:

O Audience Hub combina um imenso volume de dados com informações diversas e mais de 500 bilhões de latitudes e longitudes de cerca de 180 milhões de dispositivos no Brasil. Esses dados permitem entender como as pessoas se comportam e movimentam no mundo físico, sabendo por onde passam, onde permanecem e com que frequência visitam determinados lugares.Essa é a base do que a Hands chama de GeoBehavior, a análise comportamental aplicada à geolocalização. Através de tecnologia e filtros precisos, o GeoBehavior diferencia, por exemplo, quem apenas passou em frente a uma loja de quem realmente permaneceu e tem afinidade com aquele local ou marca.

Do “raio de 1 km” aos polígonos de precisão

Enquanto as principais plataformas de mídia digital permitem segmentar audiências por um raio geográfico mínimo (geralmente de 1 km), o Audience Hub vai muito além. A plataforma utiliza polígonos geográficos, que permitem desenhar manualmente os contornos exatos de um local, como uma loja, um shopping, um estádio, um ponto de mídia OOH ou até o local de um evento específico, aplicando filtros adicionais de data, hora e tempo de permanência, para segmentar quem esteve em um show por exemplo.

Esses polígonos possibilitam a definição das áreas de interesse e eliminam o desperdício de mídia em regiões que não fazem sentido para a marca.

Por exemplo, se uma rede de supermercados quer impactar apenas quem frequenta as lojas de um concorrente específico, é possível criar um polígono que delimita exatamente o estacionamento e o interior do estabelecimento, ignorando ruas adjacentes e áreas residenciais.

Filtros comportamentais que refinam ainda mais a audiência:

Além da precisão geográfica, o Audience Hub permite aplicar filtros de comportamento que enriquecem a qualidade das audiências. É possível filtrar usuários por:

- Período das visitas (ex.: quem visitou o local nas últimas semanas, meses ou ano)

- Data e horário das visitas (ex: visitantes de fim de semana ou em horários comerciais).

- Tempo de permanência (ex: quem ficou mais de 20 minutos em um local).

- Frequência (ex: visitantes recorrentes vs. visitantes únicos).

Essas variáveis transformam uma simples lista de dispositivos em clusters inteligentes, capazes de representar comportamentos reais e não apenas localizações pontuais.

Com isso é possível diferenciar quem mora em um determinado local ou quem apenas trabalha naquela região. Este tipo de segmentação muda completamente o público e seus costumes.

Multicanal:

Uma vez criada a audiência, o Audience Hub permite exportá-la diretamente, via criptografia SHA-256, para os principais canais de mídia digital, como Instagram, Facebook, TikTok, Microsoft, LinkedIn, Spotify, DV360 e Pinterest.

Isso significa que as marcas podem ativar campanhas personalizadas em múltiplas plataformas, mantendo a coerência da segmentação.

Por exemplo:

- Um público que frequenta academias pode ser impactado com uma campanha de bebidas esportivas no Instagram.

- Já os visitantes de concessionárias podem ser reimpactados com anúncios de manutenção automotiva no YouTube.

Essa flexibilidade torna o Audience Hub uma ferramenta poderosa para estratégias omnichannel, conectando o mundo físico ao digital com fluidez.

Da inteligência ao resultado

O objetivo final do Audience Hub é unir precisão, contexto e eficiência. Ao permitir que as marcas falem com pessoas que realmente têm potencial de conversão, a plataforma ajuda a otimizar o investimento em mídia, reduzir dispersões e gerar resultados mais mensuráveis.

Mais do que uma ferramenta de segmentação, o Audience Hub representa uma nova forma de pensar audiências, baseando-se em comportamentos reais, e não apenas em suposições generalistas.

-

Geobehavior7 meses ago

Geobehavior7 meses agoAudience Hub: como funciona a tecnologia por trás da segmentação precisa da Hands

-

Outros4 meses ago

Outros4 meses agoDBSCAN: a metodologia para o entendimento de comportamento baseado em geolocalização

-

Outros12 meses ago

Outros12 meses agoBem-vindo ao Hands Academy

-

Outros12 meses ago

Outros12 meses agoConfira os detalhes do último Hands Quiz!

-

Geobehavior12 meses ago

Geobehavior12 meses agoOOH + Estratégias Mobile

-

Outros12 meses ago

Outros12 meses agoSegmentação Geográfica com Polígonos: maior precisão, melhores resultados

-

Outros9 meses ago

Outros9 meses agoHash: o que é, como funciona e porque quem trabalha com marketing digital precisa conhecer.

-

Geobehavior12 meses ago

Geobehavior12 meses agoGeoBehavior como segmentação de Mídia Digital